Sous le capot

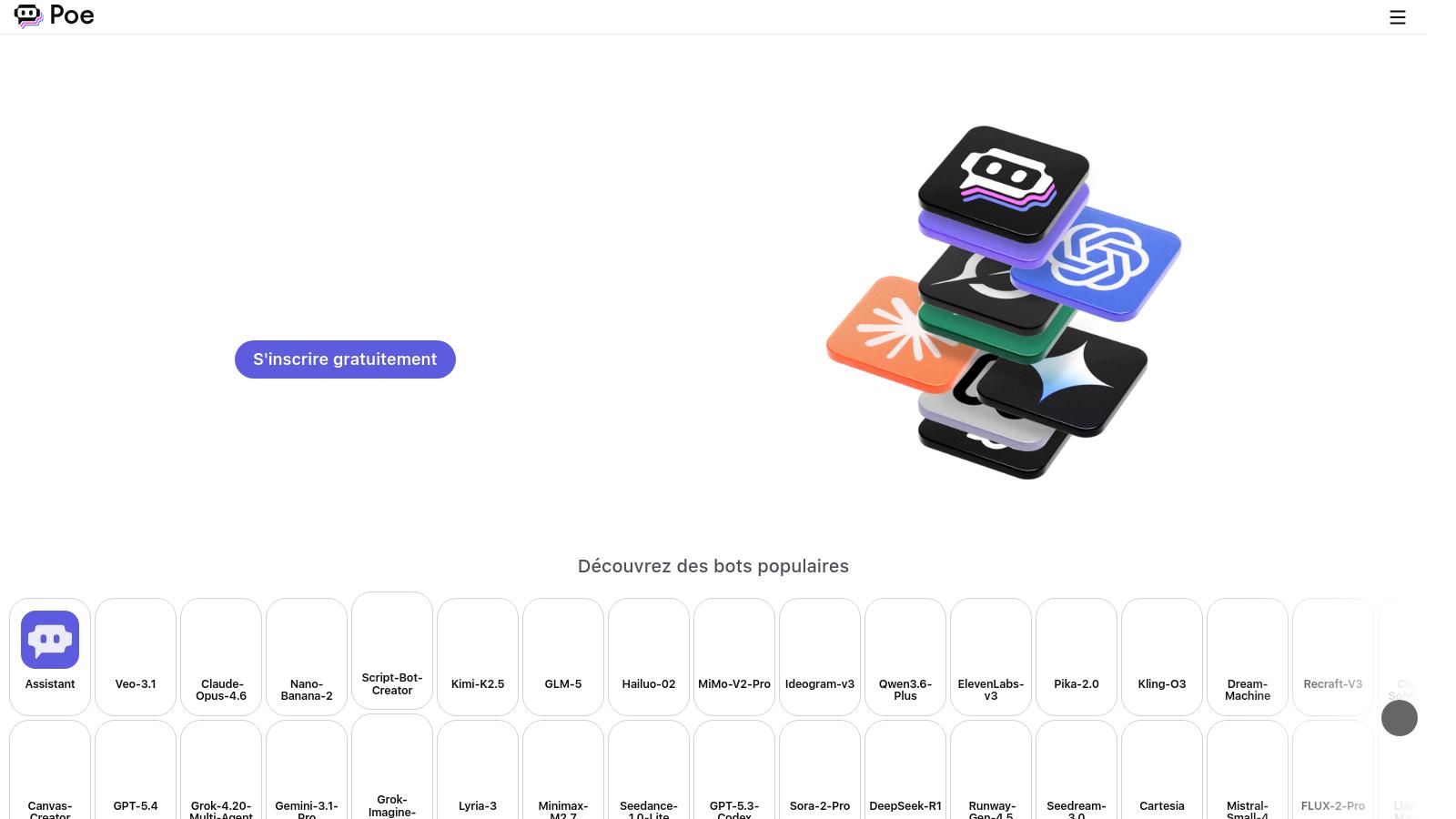

Lancé par Quora, Poe (Platform for Open Exploration) n’est pas un modèle d’intelligence artificielle. C’est une

surcouche applicative qui orchestre plusieurs API de LLM.

Techniquement, Poe agit comme un

proxy API :

- Requêtes utilisateur → Poe

- Poe → API OpenAI / Anthropic / Google

- Réponse → retour utilisateur

Conséquence directe : vous dépendez des performances et des SLA des fournisseurs tiers. En cas de latence chez Anthropic ou de throttling côté OpenAI, Poe ne peut rien corriger.

Les modèles accessibles incluent :

- OpenAI (GPT-4, GPT-4o)

- Anthropic (Claude Sonnet, Opus)

- Google (Gemini)

- Meta (Llama)

Le système économique repose sur des

compute points. Chaque requête consomme un quota selon :

- Le modèle choisi

- La taille du prompt (tokens)

- La longueur de la réponse

On retrouve ici une logique proche de la facturation API classique (tokens entrants/sortants), mais encapsulée pour masquer la complexité.

Autre brique clé : les

bots personnalisés. Vous configurez un prompt système (équivalent d’un “system role” OpenAI), des règles métier, et un comportement. Pas de fine-tuning, pas de RAG natif, mais suffisant pour des cas simples.

Poe se positionne donc comme :

- Un agrégateur de LLM

- Un sandbox de test multi-modèles

- Un outil de prototypage rapide

Ce n’est ni une plateforme MLOps, ni une solution d’industrialisation.

Mise en production

Poe s’utilise comme un SaaS classique. Aucun déploiement, aucune configuration serveur.

1. Création d’un compte

- Connexion via email ou SSO Google

- Accès immédiat à l’interface

2. Sélection du modèle

Chaque bot correspond à un modèle sous-jacent. En pratique :

- GPT-4 → logique, code, structuration

- Claude → rédaction longue, synthèse

- Gemini → cas hybrides et multimodal

3. Gestion des points

Chaque interaction décrémente votre quota. Les modèles haut de gamme (Claude Opus, GPT-4) consomment rapidement. Sur des prompts longs (>2k tokens), la consommation grimpe vite.

Sur le terrain : un usage intensif (SEO + dev + rédaction) peut vider un plan standard en quelques jours.

4. Création d’un bot personnalisé

- Interface “Create Bot”

- Définition du prompt système

- Paramétrage du comportement

- Publication ou usage interne

Voici un exemple concret : création d’un bot “audit WordPress” capable de générer des checklists techniques à partir d’un brief client.

Utilisation avancée : lancer la même requête sur 3 modèles pour comparer :

- Temps de réponse (latence)

- Qualité de sortie

- Cohérence logique

Nos bonnes pratiques

1. Réduire la fragmentation des outils IA

Dans une agence, multiplier ChatGPT Plus, Claude Pro et Gemini devient ingérable (facturation, accès, support). Poe centralise l’usage. Gain : moins de friction, mais pas forcément moins cher.

2. Benchmarker avant l’intégration par API

Avant d’intégrer un LLM en production (via API), tester les prompts dans Poe permet de valider :

- Qualité des réponses

- Robustesse des instructions

- Comportement edge-case

Ensuite seulement, vous passez en API directe.

3. Standardiser les workflows internes

Créer des bots métiers permet de limiter les dérives :

- Templates SEO homogènes

- Réponses support cadrées

- Production de contenu encadrée

Ce que poe.com fait réellement et ce que les autres articles ne disent pas

Poe.com ne remplace pas ChatGPT, Claude ou Gemini : il les met en vitrine dans une seule interface. Sa vraie valeur n’est pas de produire une IA différente, mais de vous permettre de comparer rapidement plusieurs modèles, de créer des bots simples et de centraliser vos usages sans multiplier les comptes.

Le revers est moins vendeur. Poe reste une surcouche SaaS entre vous et les fournisseurs d’IA. Vous ne contrôlez pas directement les API, la latence, la tarification réelle en tokens, ni les limites techniques des modèles. Le système de points rend l’expérience plus simple, mais il rend aussi le coût réel plus difficile à lire.

Pour tester des prompts, produire du contenu, comparer des réponses ou former une petite équipe, Poe.com a du sens. Pour bâtir un produit IA, automatiser un workflow métier ou garantir une gouvernance des données, mieux vaut passer par les API natives d’OpenAI, Anthropic, Google Vertex AI ou une solution locale.

Forces et limites de la plateforme

Ce qui fonctionne

- Interface unique pour plusieurs LLM

- Prise en main immédiate

- Bon outil de test comparatif

- Création rapide de bots

Ses limites

- Modèle économique complexe : difficile de mapper points → coût réel en tokens.

- Dépendance totale aux API externes : aucun contrôle sur roadmap ou pricing.

- Pas de gouvernance data : aucune garantie fine sur stockage ou usage des prompts.

- Latence variable : dépend du modèle et de la charge réseau.

Et du coté des tarifs ?

| Plan |

Points |

Prix annuel |

Équivalent mensuel |

| Starter |

10 000 points / jour |

57,49 € |

4,79 € |

| Standard |

660 000 points / mois |

229,99 € |

19,99 € |

| Pro |

1,65 million / mois |

574,99 € |

49,99 € |

| Business |

3,3 millions / mois |

1 149,99 € |

99,99 € |

| Enterprise |

8,25 millions / mois |

2 874,99 € |

249,99 € |

plus vous utilisez des modèles premium, plus le coût réel s’éloigne du prix affiché.

5 alternatives crédibles à considérer

| Produit | Différenciateur clé | Lien |

|---|

| ChatGPT | Accès direct aux modèles OpenAI | Accéder |

| Claude | Gestion avancée du contexte long | Accéder |

| Gemini | Intégration native Google Workspace | Accéder |

| Perplexity AI | Recherche web augmentée en temps réel | Accéder |

| Jan.ai | Exécution locale sans cloud | Accéder |

Conclusion

Poe répond à un besoin réel : simplifier l’accès aux modèles IA sans gérer plusieurs comptes.

Mais dès que vous entrez dans une logique :

- d’automatisation

- d’intégration backend

- ou de maîtrise des coûts

la limite est atteinte.